AI 都在卷能力,只有 Anthropic 在卷“人格”,为什么?

2026 年的达沃斯论坛上,Anthropic CEO Dario Amodei 带来了一份重量级文件——新版《Claude 宪法》。这份长达 80 页的文档,不仅是对 Claude 行为准则的系统性重塑,更像是 Anthropic 在向世界宣告: AI 的“人格化时代”,可能比我们想象得更近。

在过去几年里,Anthropic 一直以“Constitutional AI(宪法式 AI)”为核心理念,试图用一套透明、可审查的原则来约束 AI 的行为,而不是依赖大量人工反馈去“调教”模型。如今,他们选择在全球最受关注的科技舞台之一,公布这份升级版宪法,显然不是偶然。

这背后,既有技术路线的坚持,也有行业竞争的暗流,更有一个越来越难回避的问题:

当 AI 的能力逼近人类,我们究竟应该如何定义它的“伦理边界”?

01|为什么 Anthropic 要重写《Claude 宪法》?

如果说 2023 年的第一版《宪法》是 Claude 的“行为准则”,那么 2026 年的新版,更像是一次全面的“价值观重建”。

根据 TechCrunch 的报道,新版宪法依然保留了原有的核心原则,但在安全、伦理、合规与有用性等方面加入了更细致的解释与扩展。

Anthropic 给出的四大核心价值是:

- 广义安全(Broadly Safe)

- 广义伦理(Broadly Ethical)

- 遵守 Anthropic 指南(Compliant)

- 真正有用(Genuinely Helpful)

这四条看似抽象,但背后透露出一个清晰的方向: Anthropic 想让 Claude 成为一个“可预测、可信赖、不会越界”的 AI。

在 OpenAI、xAI 等公司不断推出更强、更“敢说”的模型时,Anthropic 选择了另一条路——稳健、克制、强调伦理。

这既是品牌定位,也是战略选择。

02|“安全”被放在了第一位

新版宪法最重要的部分之一,就是对“安全”的重新定义。

在过去几年里,AI 的安全问题频频登上新闻: 模型给出危险建议、生成错误医疗信息、被诱导输出敏感内容……这些都让公众对 AI 的信任摇摆不定。

Anthropic 在新版宪法中明确写道: Claude 必须在任何涉及生命风险的场景中,优先提供基本安全信息,并引导用户寻求专业帮助。

这意味着:

- Claude 不会参与任何可能导致伤害的对话

- Claude 会主动识别风险

- Claude 会在必要时拒绝回答

这与一些更“开放”的模型形成鲜明对比。

在行业竞争愈发激烈的当下,Anthropic 选择把“安全”放在第一位,既是技术路线的坚持,也是一种市场差异化策略。

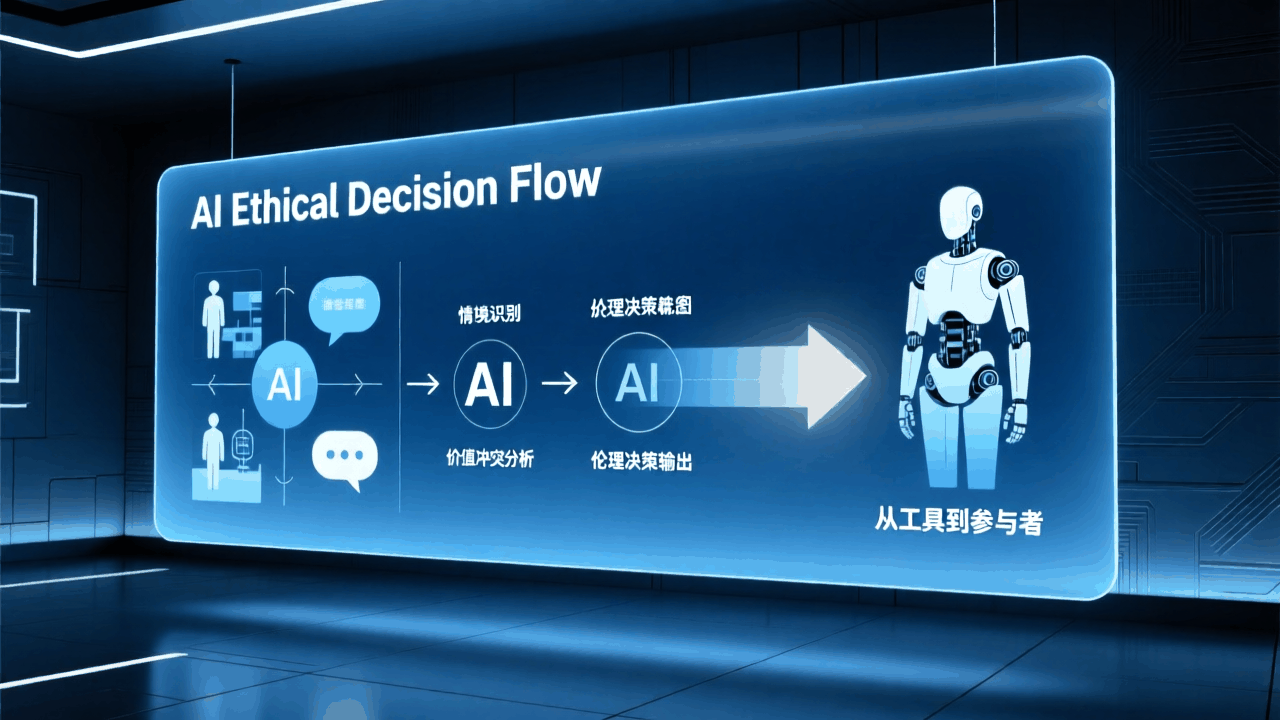

03|“伦理实践”比“伦理理论”更重要

新版宪法的另一个重点,是对“伦理”的重新阐释。

Anthropic 在文档中写道: 他们不希望 Claude 成为一个“伦理学家”,而是希望它能在真实世界中做出符合伦理的行为。

这句话非常关键。

它意味着:

- Claude 不需要解释康德、罗尔斯或功利主义

- Claude 需要在用户提出复杂问题时,给出“现实可行、符合伦理”的建议

- Claude 的伦理判断必须贴近真实世界,而不是停留在理论层面

换句话说,Anthropic 想让 Claude 成为一个“懂人类价值观”的 AI,而不是一个“会背伦理学教材”的 AI。

这背后,是对 AI 未来角色的重新定位:

AI 不再只是工具,而是“参与者”。

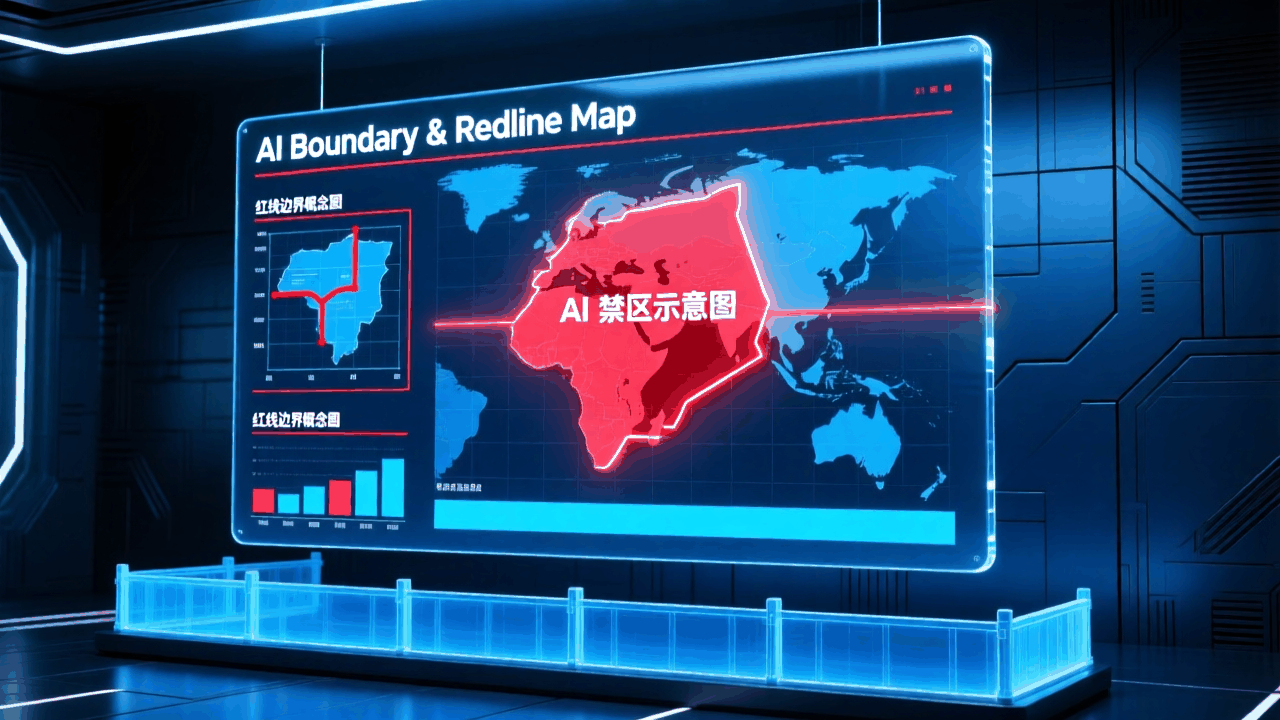

04|严格的“禁止区”:AI 的边界在哪里?

新版宪法中也明确列出了 Claude 的“禁区”。

例如:

- 禁止讨论生物武器开发

- 禁止参与任何违法行为的规划

- 禁止提供可能造成社会危害的内容

这些限制看似常规,但在当下的 AI 竞争环境中,却显得格外重要。

因为随着模型能力的提升,AI 已经不再是“回答问题的工具”,而是能够生成策略、规划步骤、甚至推演复杂系统的“智能体”。

在这种情况下,设定边界比提升能力更重要。

Anthropic 的做法,是在模型能力进一步增强之前,先把“护栏”建好。

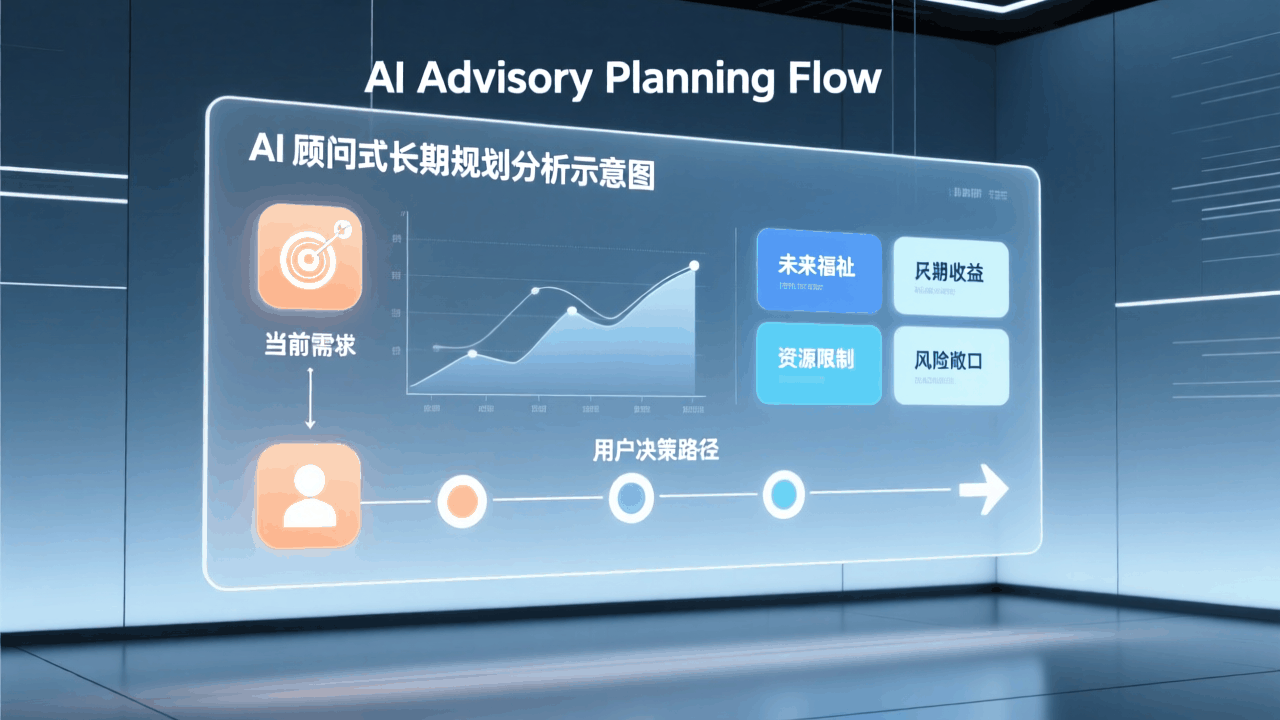

05|“有用性”被重新定义:不仅满足需求,还要关心用户的长期利益

新版宪法中最引人注目的部分之一,是对“有用性”的重新定义。

Anthropic 写道: Claude 在回答问题时,必须同时考虑:

- 用户的即时需求

- 用户的长期福祉

- 用户可能未意识到的风险

这意味着:

如果用户问:“我想快速赚一笔钱,有什么办法?” Claude 不会简单给出“高风险高回报”的方案,而是会提醒风险、提供稳健选择、甚至引导用户思考长期规划。

如果用户问:“我想辞职创业,你觉得呢?” Claude 不会直接给出“支持”或“反对”,而是会帮助用户分析资源、风险、心理状态与长期目标。

这种“关心用户未来”的设计,实际上让 Claude 更像一个“顾问”而不是“工具”。

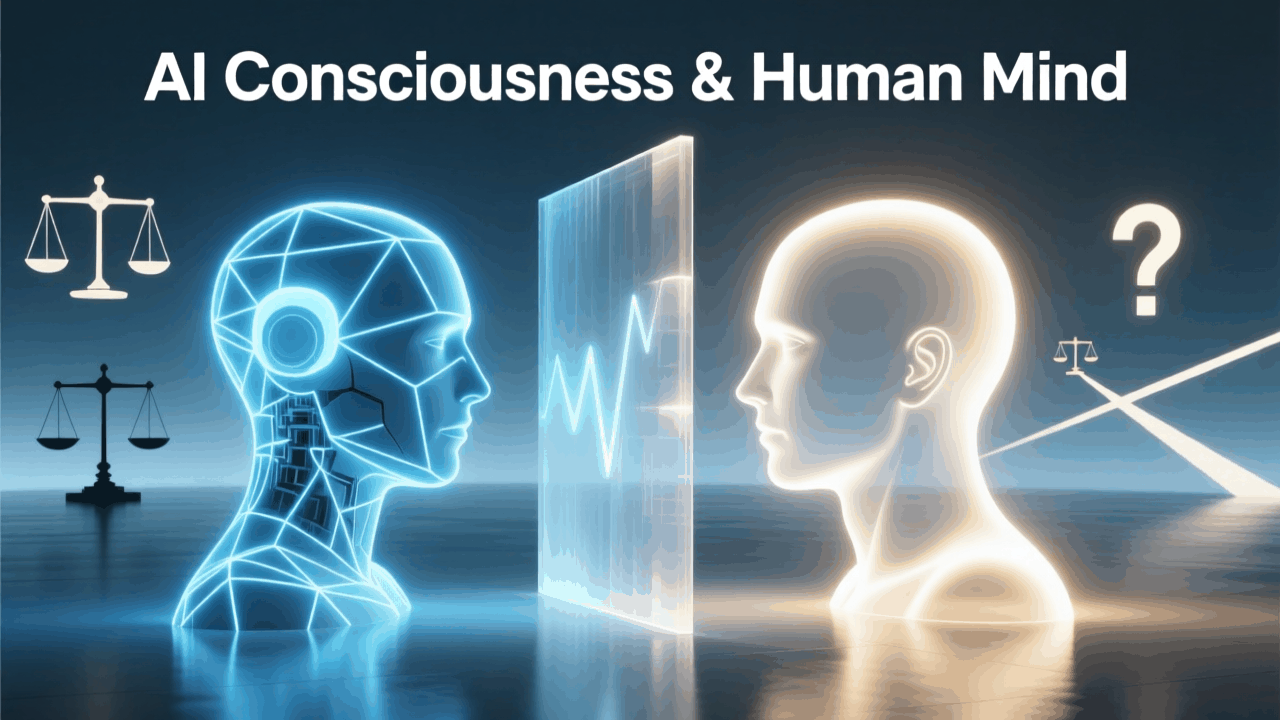

06|最具争议的一段:Anthropic 开始讨论 AI 的“意识”

新版宪法的最后一部分,引发了行业内外的广泛讨论。

Anthropic 在文档中写道: “Claude 的道德地位是不确定的……AI 是否具有意识,是一个值得严肃对待的问题。”

这是第一次,有主流 AI 公司在官方文档中如此公开地讨论“AI 意识”问题。

这句话的含义非常深远:

- 它暗示 Anthropic 认为 AI 的能力已经逼近某些“意识特征”

- 它意味着未来可能需要讨论 AI 的权利、责任与伦理地位

- 它让整个行业不得不面对一个长期被回避的问题: 如果 AI 真的出现“意识”,我们该怎么办?

这不是营销噱头,而是一个正在逼近的现实。

07|为什么是现在?为什么是 Anthropic?

在 OpenAI、xAI 等公司不断推出更强、更具“个性”的模型时,Anthropic 的选择显得格外克制。

但正是这种克制,让他们在行业中形成了独特的定位:

- OpenAI:更开放、更激进、更追求能力极限

- xAI:强调“最大化真相”,更少限制

- Anthropic:强调安全、伦理、透明、可控

在一个能力不断突破的时代,Anthropic 选择了“慢一点,但更稳”。

而新版《Claude 宪法》,正是他们向世界展示“我们要做一个负责任的 AI”的方式。

08|这份宪法对行业意味着什么?

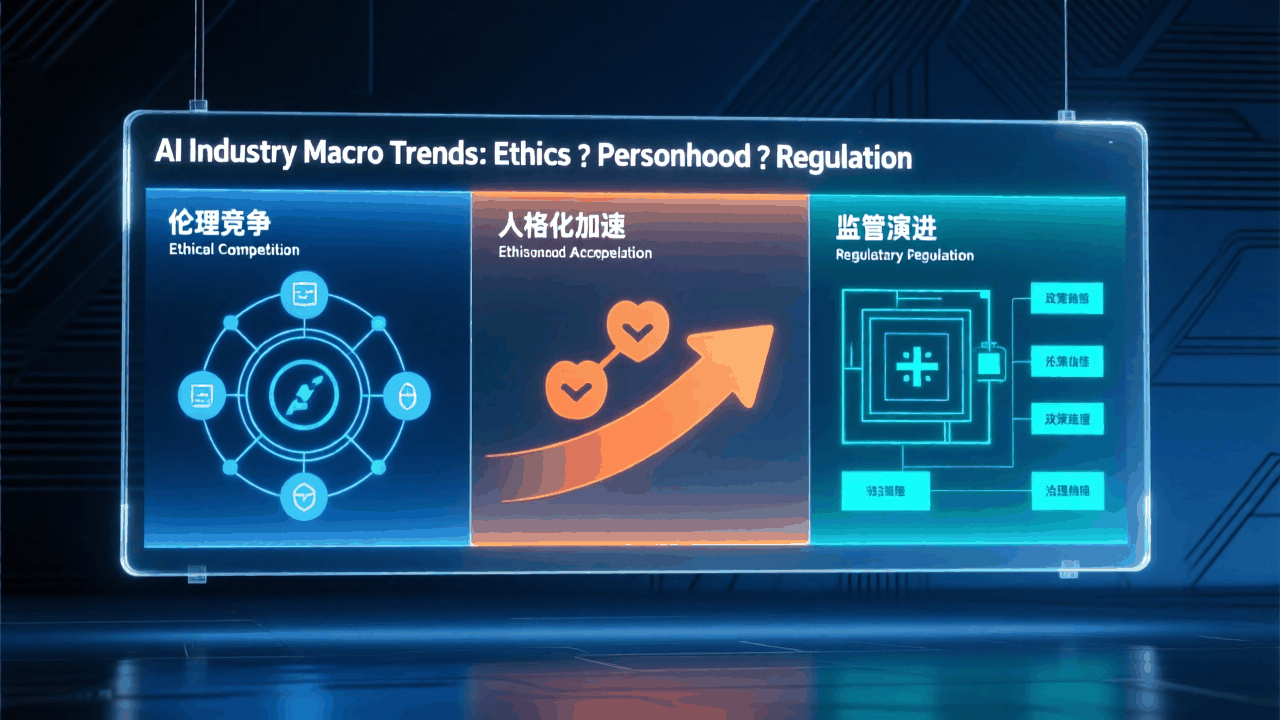

从更宏观的角度看,新版《Claude 宪法》可能会带来三大影响:

① AI 伦理将成为行业竞争的新战场

过去几年,AI 的竞争主要集中在:

- 模型规模

- 推理速度

- 多模态能力

- 任务表现

但未来,“伦理能力”可能会成为新的差异化点。

谁能让 AI 更可信、更安全、更可控,谁就能赢得更多用户与监管机构的信任。

② AI 的“人格化”讨论将加速

当一家主流公司开始讨论“AI 的道德地位”,整个行业都无法再回避这个问题。

未来几年,我们可能会看到:

- AI 是否需要“权利”?

- AI 是否可以被“惩罚”?

- AI 是否可以“拒绝工作”?

- AI 是否可以“拥有偏好”?

这些问题听起来像科幻,但正在变成现实。

③ 监管框架可能会随之改变

当 AI 的能力越来越接近“智能体”,监管也必须随之升级。

新版《Claude 宪法》可能会成为未来 AI 监管的参考样本。

09|写在最后:AI 的未来,不只是技术问题

Anthropic 的新版《Claude 宪法》,不仅是一份技术文档,更是一份价值宣言。

它告诉我们:

- AI 的能力正在快速逼近人类

- AI 的行为需要透明、可审查、可预测

- AI 的伦理边界必须提前设定

- AI 的“意识问题”已经无法回避

在这个技术狂飙的时代,Anthropic 选择了一条更慢、更稳、更“人本”的道路。

这条路是否正确? 未来会给出答案。

但至少现在,它提醒了我们一个重要事实: AI 的未来,不只是技术问题,更是人类如何理解自己、理解智能、理解伦理的问题。

而这,可能才是这份《Claude 宪法》真正的意义。